La directive sur les robots étendus de Google ne fonctionne pas pour l’expérience générative de recherche

Il y a quelques semaines, Google a publié une nouvelle directive robots.txt pour indiquer à Google de ne pas utiliser votre contenu pour Bard ou d’autres projets d’IA Google – Google-Extended. L’expérience générative de recherche Google n’utilise actuellement pas Google-Extended, m’a dit Google. Cela signifie que les réponses générées par l’IA de SGE peuvent continuer à s’afficher à moins que vous ne bloquiez complètement Googlebot.

Google a écrit, que ces robots Google-Extended indiqueraient à Google de ne pas utiliser votre contenu pour améliorer « les API génératives Bard et Vertex AI, y compris les futures générations de modèles qui alimentent ces produits ». Au départ, je pensais que cela s’appliquait aux instantanés générés par l’IA fournis par Google SGE, mais ce n’est pas le cas.

Un porte-parole de Google m’a dit : « SGE est une expérience de recherche, les administrateurs de sites Web doivent donc continuer à utiliser l’agent utilisateur Googlebot via robots.txt et la balise méta NOINDEX pour gérer leur contenu dans les résultats de recherche, y compris des expériences telles que Search Generative Experience. »

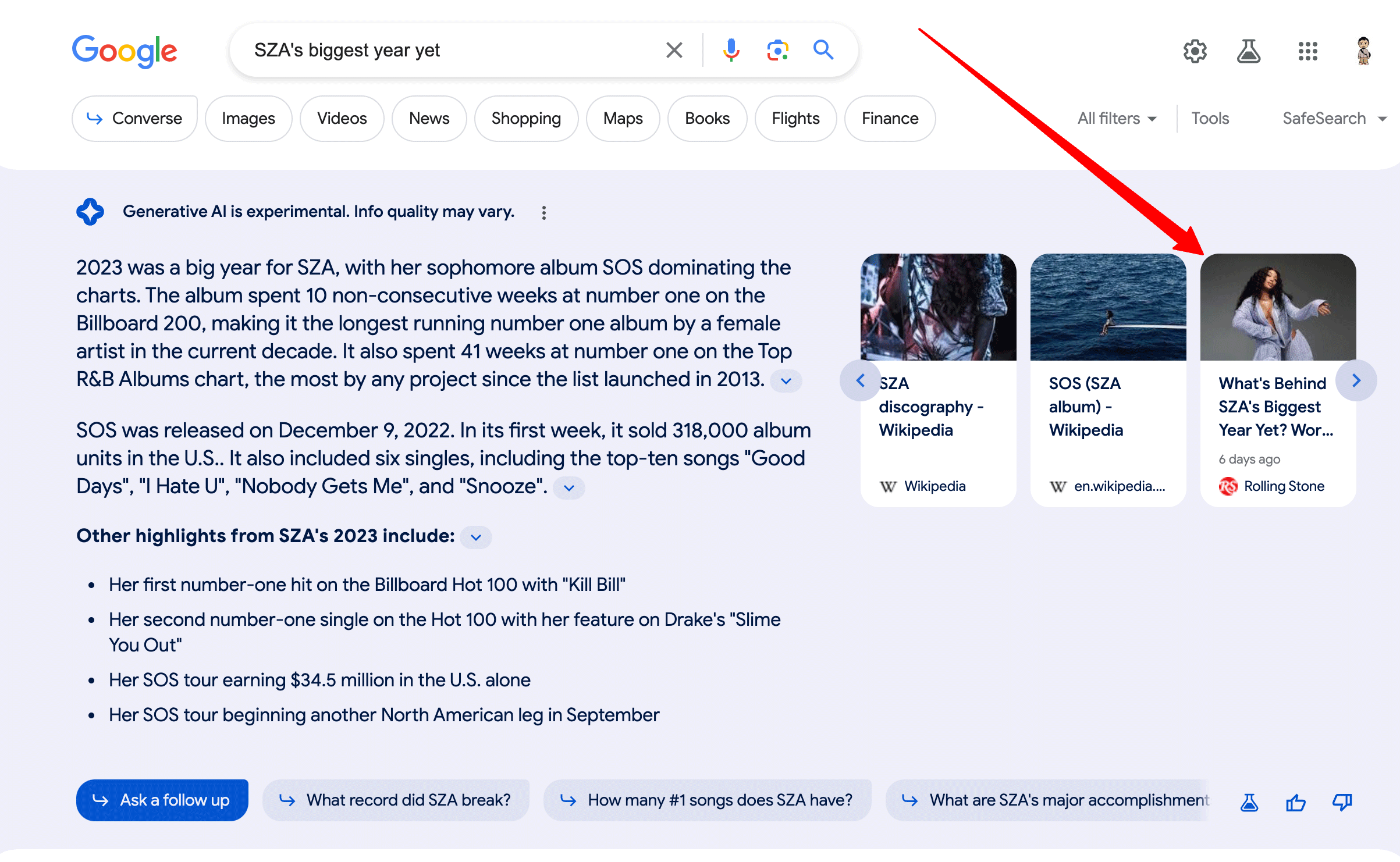

Par exemple, voici une réponse générée par l’IA de SGE qui inclut une carte du site Web des Rolling Stones :

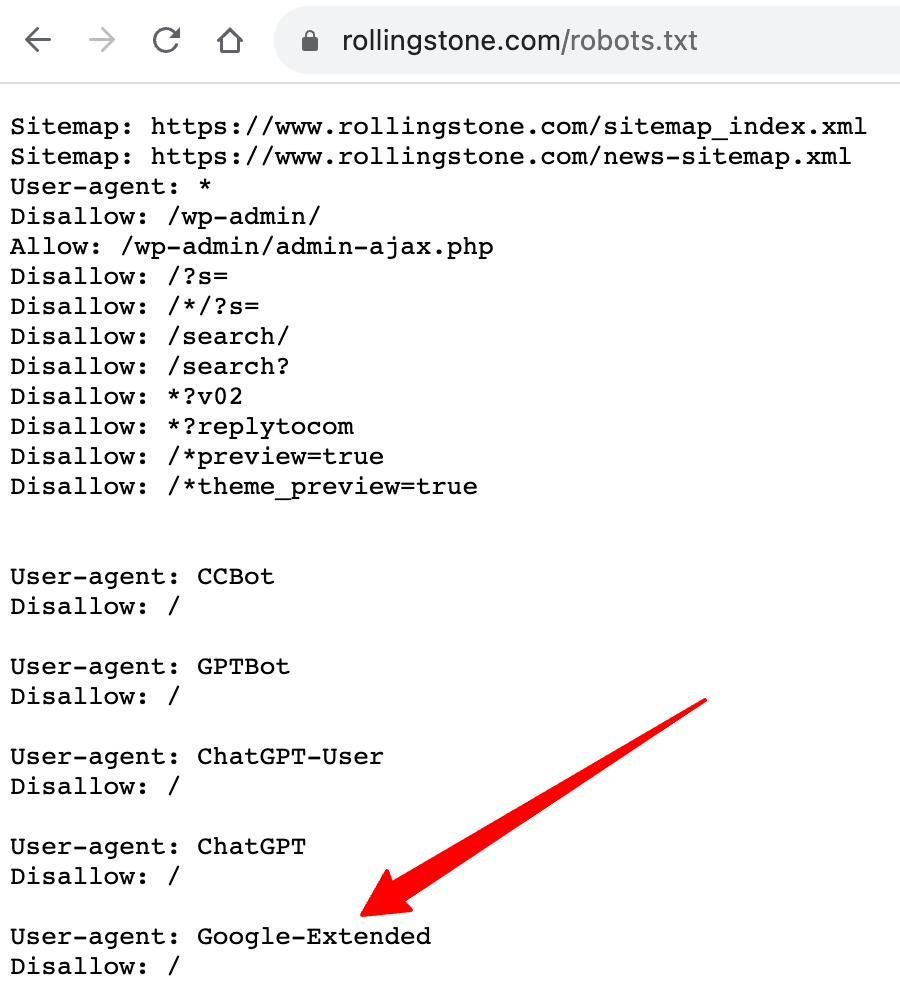

Si vous regardez leur robots.txt fichier, Google-Extended l’a répertorié ici :

Glenn Gabe a partagé un autre exemple, mais au moment où j’ai écrit cet article, SGE n’affiche plus VentureBeat dans SGE pour cette requête :

Cela ne semble pas être le cas. J’en ai parlé hier. Je viens également de vérifier un autre exemple basé sur un article qui vient d’être publié et Venturebeat figurait dans la réponse SGE, même s’il est bloqué par Google-Extended. pic.twitter.com/aSbUMbnZG4

–Glenn Gabe (@glenngabe) 8 octobre 2023

Étant donné que SGE est intégré à la recherche, Google semble croire que les éditeurs Web acceptent de ne pas appliquer Google-Extended pour les instantanés d’IA dans SGE. « Le contexte est que l’IA est intégrée à la recherche, et non intégrée, et fait partie intégrante du fonctionnement de la recherche. C’est pourquoi robots.txt est le contrôle permettant aux éditeurs Web de gérer l’accès à la façon dont leurs sites sont explorés. Comme vous le savez. , nous utilisons l’IA et les grands modèles linguistiques dans la recherche depuis de nombreuses années non seulement pour améliorer considérablement la qualité de nos résultats, mais également pour introduire des méthodes de recherche uniques, comme Lens et la recherche multiple. Ces efforts ont continué à améliorer notre capacité à connecter les gens. avec des pages Web plus pertinentes et envoyer un trafic précieux vers l’écosystème », a ajouté un porte-parole de Google.

Tes pensées?

Discussion sur le forum à X.